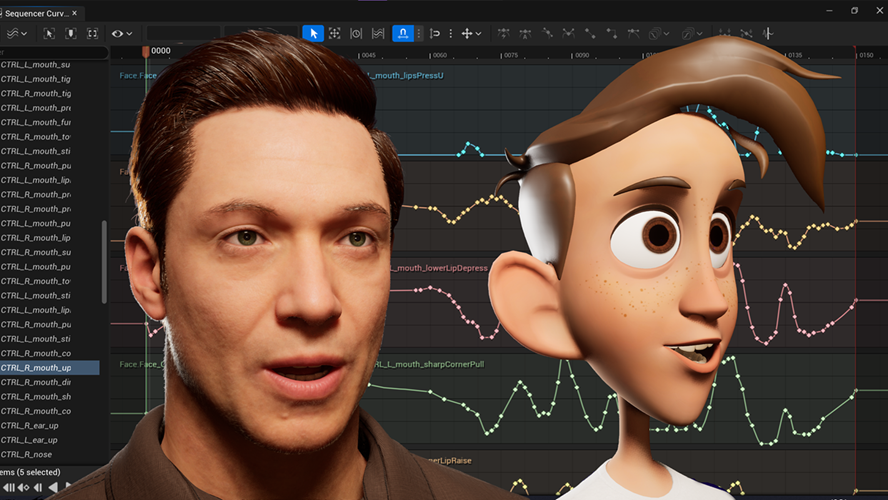

Pionnière en modélisation de la parole et en synthèse vocale audiovisuelle, la start-up Dynalips est officiellement lancée. Issue des travaux de recherche du Loria (CNRS, Université de Lorraine, Inria, CentraleSupélec), ayant fait l’objet d’un programme de maturation de la Société d’Accélération du Transfert de Technologie – SATT Sayens et accompagnée par l’Incubateur Lorrain, elle propose aux animateurs et aux développeurs de jeux vidéo une solution de synchronisation labiale (lipsync) innovante pour synchroniser précisément, automatiquement et rapidement les mouvements des lèvres d’un personnage 3D ou 2D avec la parole.

Le secteur de l’animation est en constante évolution, avec des décors, des effets spéciaux et des personnages de plus en plus réalistes. Mais qu’en est-il de la parole des personnages ? Un des défis à relever pour les animateurs professionnels est de modéliser les mouvements de la bouche et les expressions faciales. Actuellement, l’animation labiale est loin d’être parfaite, car elle ne prend pas en compte la coarticulation, un phénomène où la prononciation d’un son est influencée par les sons qui l’entourent.

La start-up Dynalips offre une solution de synchronisation labiale automatique basée sur les derniers résultats de la recherche dans le domaine. Elle prend notamment en compte la coarticulation, essentielle pour permettre une parole plus fluide, naturelle, et surtout intelligible.